To przerobiony materiał z fałszywym przekazem o zatrzymaniu Ukraińców za kradzieże po ostrzałach Dubaju

- Opublikowano 11/03/2026, 16:19

- Przeczytasz w ciągu 5 minut

- Autor: Maja CZARNECKA, AFP Polska

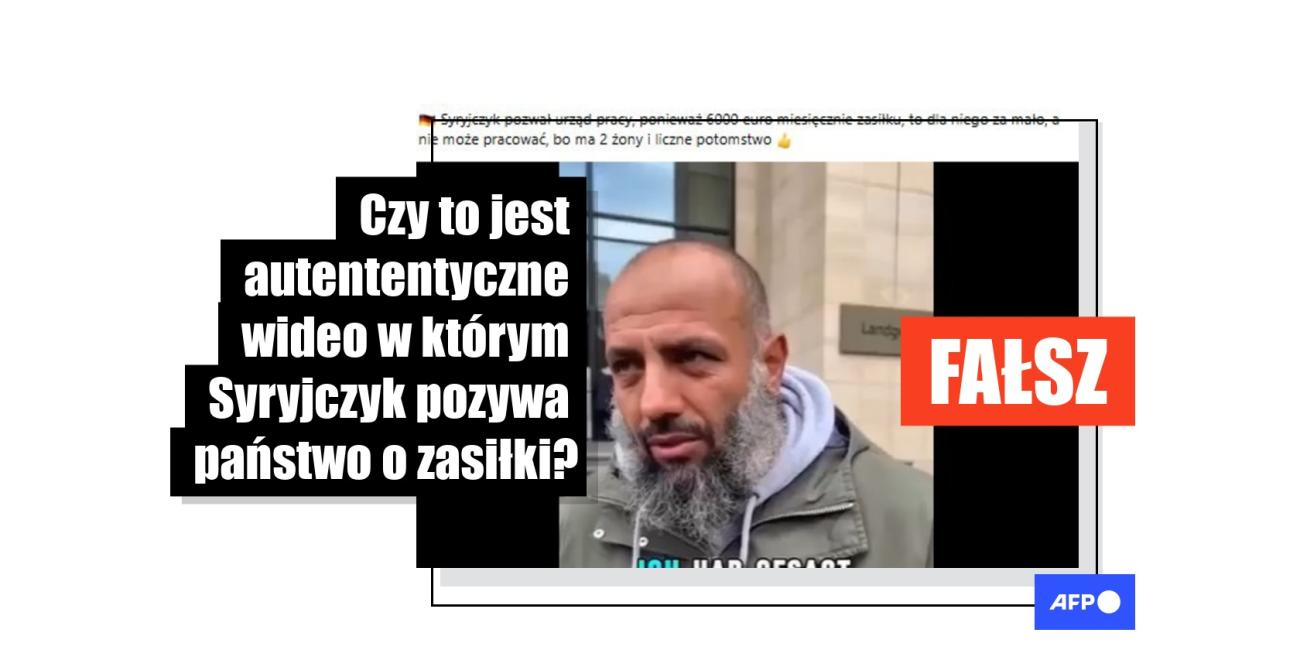

Po ataku Izraela i Stanów Zjednoczonych na Iran 28 lutego 2026 roku, Teheran w odwecie zaatakował miasta Zjednoczonych Emiratów Arabskich, w tym Dubaj, wystrzeliwując w jego kierunku drony i rakiety. W tym kontekście w polskich mediach społecznościowych zaczął krążyć film wyglądający na materiał informacyjny wraz z twierdzeniem, że grupy Ukraińców rabowały sklepy jubilerskie i kradły porzucane samochody w Dubaju. Przeprowadzona przez AFP weryfikacja wykazała jednak, że wideo podszywa się pod autentyczny materiał redakcji Euronews, a jego ścieżka dźwiękowa została przerobiona przy użyciu narzędzi sztucznej inteligencji. Dziennikarka stacji w oryginalnym materiale nie wypowiadała żadnych takich słów. Stacja również potwierdziła, że nagranie zostało zmanipulowane.

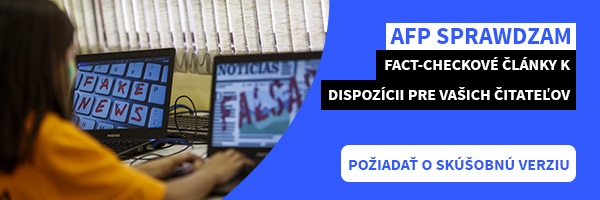

„W Dubaju grupy Ukraińców rabują sklepy jubilerskie i porzucone samochody. Policja ryzykując życie pod atakami rakiet i dronów aresztowała 19 obywateli Ukrainy, złapanych na okradaniu sklepów jubilerskich. Grupy tworzy 9000 Ukraińców pracujących w Dubaju” – głosi post na Facebooku z 5 marca 2026 roku wraz wideo wyglądającym jak materiał informacyjny telewizji Euronews. Słyszymy w nim dziennikarkę zdającą się mówić o ukraińskich obywatelach „rabujących sklepy w Dubaju”. Wygląda jakby mówiła: „lokalna policja zatrzymała 19 mężczyzn pochodzenia ukraińskiego, którzy rzekomo zostali przyłapani na kradzieży”. Wideo nosi logo Euronews w prawym górnym rogu oraz informację z lokalizacją geograficzną relacji oraz jej datą (28 luty 2026 r.) w lewym rogu.

Wideo stało się wiralem w języku polskim, pojawiło się na Tik Tok-u a także na platformie X ( tutaj, tutaj), zyskując łącznie ponad 1,4 tys. udostępnień.

Film pojawił się też w języku szwedzkim i był podawany dalej przez czeskiego użytkownika. Najwcześniej udostępniali go od 3 marca rosyjskojęzyczni użytkownicy m.in. na platformie X, Tik Tok-a a także na Telegramie.

Jednak nagranie to jest przeróbką. AFP ustaliła, że w oryginalnym materiale telewizyjnym w ogóle nie wspomniano o Ukraińcach, a narzędzia do wykrywania treści generowanych przez sztuczną inteligencję (AI) wykazały, że fragment dotyczący tych rzekomych faktów został wygenerowany przy użyciu AI.

Relacja na żywo po pierwszych atakach irańskich w Dubaju

Odwrotne wyszukiwanie wideo kadrów z dziennikarką, którą widać w materiale doprowadziło nas do materiału na profilu stacji telewizyjnej Euronews na Facebooku z 28 lutego 2026 roku (zarchiwizowany link). We wpisie czytamy, że „dziennikarka Euronews Jane Witherspoon relacjonuje z Dubaju chaos ogarniający miasto w związku z atakami irańskich dronów Shahed na dzielnice mieszkalne”.

Dziennikarka mówi, że hotel Fairmont, położony na wyspach Palma Dżamira w Dubaju, został trafiony „przez coś, co wygląda jak dron Shahed”. Wyjaśnia, że w lokalnych supermarketach panuje wzmożony ruch, ponieważ ludzie robią zapasy, „ale ogólnie rzecz biorąc, wydaje się, że ludzie zachowują czujność i stosują się do zaleceń, by pozostać w domach i dbać o bezpieczeństwo” – mówi na koniec.

W sobotę 28 lutego wybuchy wstrząsnęły sztucznie usypaną wyspą Palma Dżamira, kiedy Iran odpowiedział na bezprecedensowy atak Izraela i Stanów Zjednoczonych i wystrzelił setki dronów i rakiet na Zjednoczone Emiraty Arabskie oraz na innych sojuszników USA w Zatoce. W pierwszych atakach USA I Izraela, które mają na celu obalić władze w kraju rządzonym przez duchownych islamskich, zginał Ajatollah Ali Chamenei, najwyższy przywódca Iranu od 1989 roku.

Na pierwszy rzut oka oba materiały – zarówno wiralowy film jak i relacja Euronews – wyglądają podobnie. Jednak po dokładnym porównaniu stwierdziliśmy, że wiralowe nagranie jest znacznie dłuższe (trwa 1 minutę 7 sekund) niż materiał Euronews (który trwa 38 sekund). W tym pierwszym nagraniu, po tym jak Witherspoon mówi „pozostając czujnym” ok. 30. sekundy, pojawia się nienaturalna przerwa w głosie dziennikarki, która następnie rzekomo zaczyna relacjonować zdarzenia jakoby „ukraińscy szabrownicy pojawili się w Dubaju”. „W ciągu zaledwie kilku godzin grupy Ukraińców rozpoczęły rabunek sklepów jubilerskich i kradną porzucone samochody” - miała twierdzić.

W krążącym w sieci filmie pojawiają się też zupełnie inne obrazy: na ekranie nie widać już korespondentki, pojawia się za to sekwencja zdjęć i ujęć stockowych, bez jakiegokolwiek opisu tego, co przedstawiają.

W oryginalnym nagraniu, na koniec, Witherspoon mówi po prostu: „Ale ogólnie rzecz biorąc, ludzie wydają się zachowywać czujność i stosować do zaleceń, by zostać w domach i dbać o bezpieczeństwo”, a materiał kończy się planszą z logo Euronews. Nie wspomina ani słowem o Ukraińcach.

Przeprowadziliśmy wyszukiwanie według słów kluczowych jednak ani w wyszukiwarce Google, ani na stronie internetowej Euronews nie znaleźliśmy żadnych pasujących do przekazu wyników dotyczących rzekomego zatrzymania 19 Ukraińców, którzy mieli zostać przyłapani na kradzieży w Dubaju.

Stacja Euronews zareagowała na manipulację w artykule z 10 marca, w który stwierdziła, że jej relacja z Dubaju została „wykorzystana do szerzenia dezinformacji na temat wojny na Bliskim Wschodzie”, co stanowi kolejny przykład „kampanii dezinformacyjnej, którą można powiązać z prorosyjskimi aktorami dezinformacji” (zarchiwizowany link).

„Według analityków z kolektywu Antibot4Navalny kampania ta jest powiązana z operacją „Matrioszka”, związaną z Rosją, która prowadzi na masową skalę skoordynowane kampanie dezinformacyjne w mediach społecznościowych i w sieci, wymierzone w Ukrainę i Zachód” – wskazał Euronews (zarchiwizowany link).

Agencja AFP niedawno obaliła podobny przykład przerobionego materiału Euronews, który pojawił się wśród słowackich użytkowników internetu. Według przerobionej przy użyciu narzędzi AI relacji za katastrofą kolejową w Hiszpanii mieli stać ukraińscy terroryści.

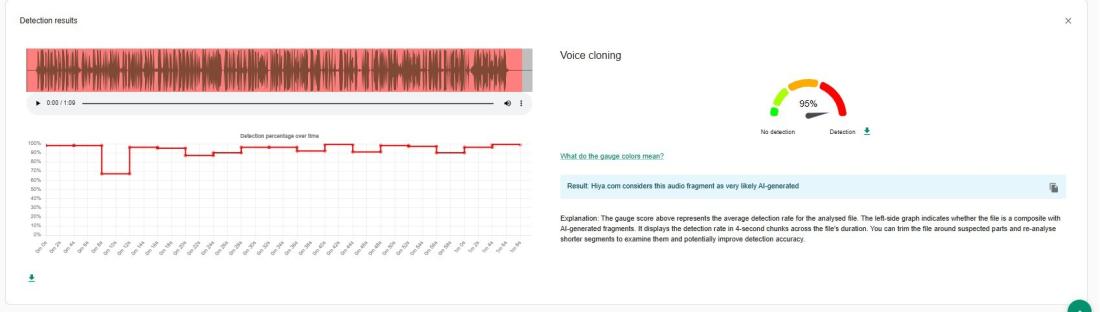

Audio wygenerowane przy użyciu sztucznej inteligencji

Analiza dźwięku nagrania z najstarszych postów w języku rosyjskim na platformie X przeprowadzona przy pomocy wtyczki InVID-WeVerify plugin, korzystającej z aplikacji Hiya do rozpoznawania sztucznie wygenerowanych połączeń głosowych, wykazała 95-procentowe prawdopodobieństwo, że ścieżka dźwiękowa w filmie została stworzona przy użyciu sztucznej inteligencji.

Jak wyjaśniliśmy w weryfikacji na naszym słowackim portalu fact-checkingowym, które analizuje podobne fałszywe nagranie, narzędzie Hiya wykrywa ślady wygenerowania przez AI niezależnie od tego, czy część treści pochodzi z innego, wcześniejszego filmu.

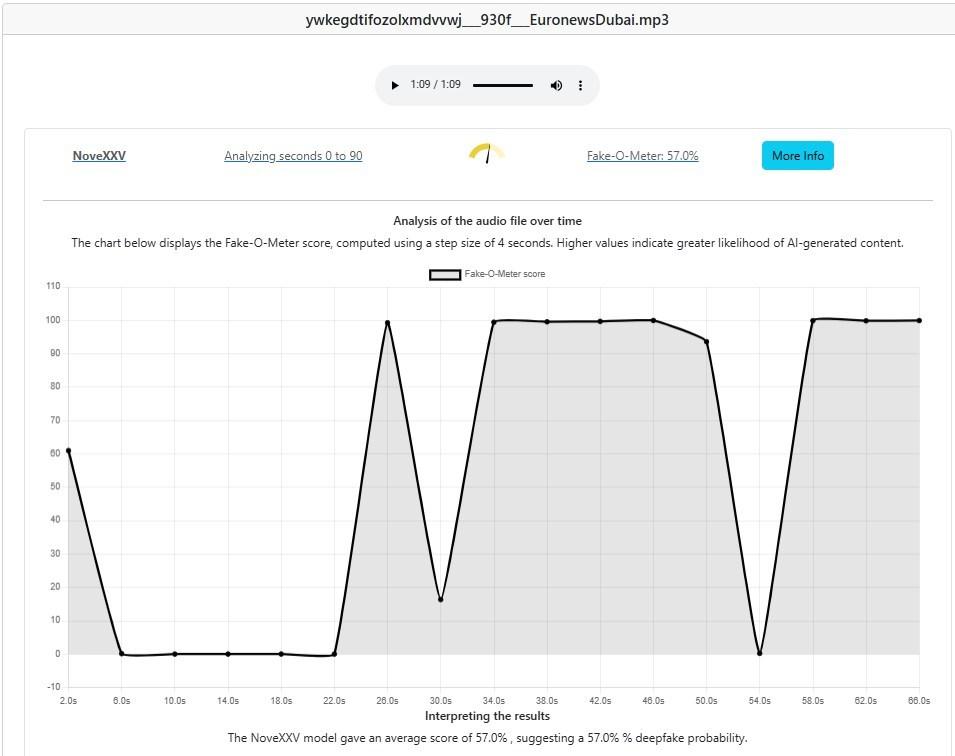

Wykonując dodatkową analizę audio tego samego materiału przy użyciu narzędzia Deepfake-total.com, stworzonego przez Instytut Fraunhofera ds. Bezpieczeństwa Stosowanego i Zintegrowanego, czołowej instytucji badawczej w Niemczech, otrzymaliśmy 57% wskaźnik prawdopodobieństwa, iż ścieżka dźwiękowa nagrania została sztucznie wygenerowana, niższy gdyż analiza podaje średnią z całego audio.

Otwierając zakładkę „Więcej informacji” o analizie, zauważymy że gwałtowne zmiany linii ścieżki audio przypadaja ok. 30 sekundy nagrania, w tym samym momencie, w którym stwierdziliśmy manipulacje dźwięku i obrazu.

Nagraniu przyjrzała się również litewska organizacja fact-checkingowa 15min.lt a także ukraińskie media, które wykazały że zostało ono zmanipulowane.

Również Centrum Przeciwdziałania Dezinformacji (CDC) przestrzegało na swojej stronie i na platformie X przed ostatnimi przypadkami rosyjskiej propagandy, która „wykorzystuje kontekst wydarzeń na Bliskim Wschodzie dla szerzenia swoich narracji”.

Copyright © AFP 2017-2026. Jakiekolwiek komercyjne wykorzystywanie powyższych treści wymaga subskrypcji serwisu. Więcej informacji znajdą Państwo pod tym linkiem.

Zastanawiasz się czy informacja jest prawdziwa? Napisz do nas. Sprawdzimy

Skontaktuj się z nami