Nagranie z atakiem rakietowym na Tel Awiw zostało wytworzone przez AI

- Opublikowano 06/03/2026, 14:26

- Przeczytasz w ciągu 5 minut

- Autor: Pierre MOUTOT, AFP Francja, AFP Polska

- Tłumaczenie: Maja CZARNECKA

Potężny atak Stanów Zjednoczonych i Izraela na Iran w sobotę 28 lutego 2026 roku doprowadził do wybuchu regionalnej wojny na Bliskim Wschodzie. Teheran odpowiedział odwetem, wystrzeliwując rakiety w kierunku Izraela, a także państw Zatoki Perskiej, na których terytorium znajdują się amerykańskie bazy wojskowe. W tym kontekście w sieci pojawiło się nagranie, które rzekomo ma przedstawiać irański ostrzał rakietowy Tel Awiwu, największego miasta w Izraelu. Jednak film, który zdobył w sieci miliony wyświetleń, został wygenerowany za pomocą sztucznej inteligencji. Nie ma śladów wiarygodnych doniesień o ostrzałach podobnych do tych, które film miałby przedstawiać.

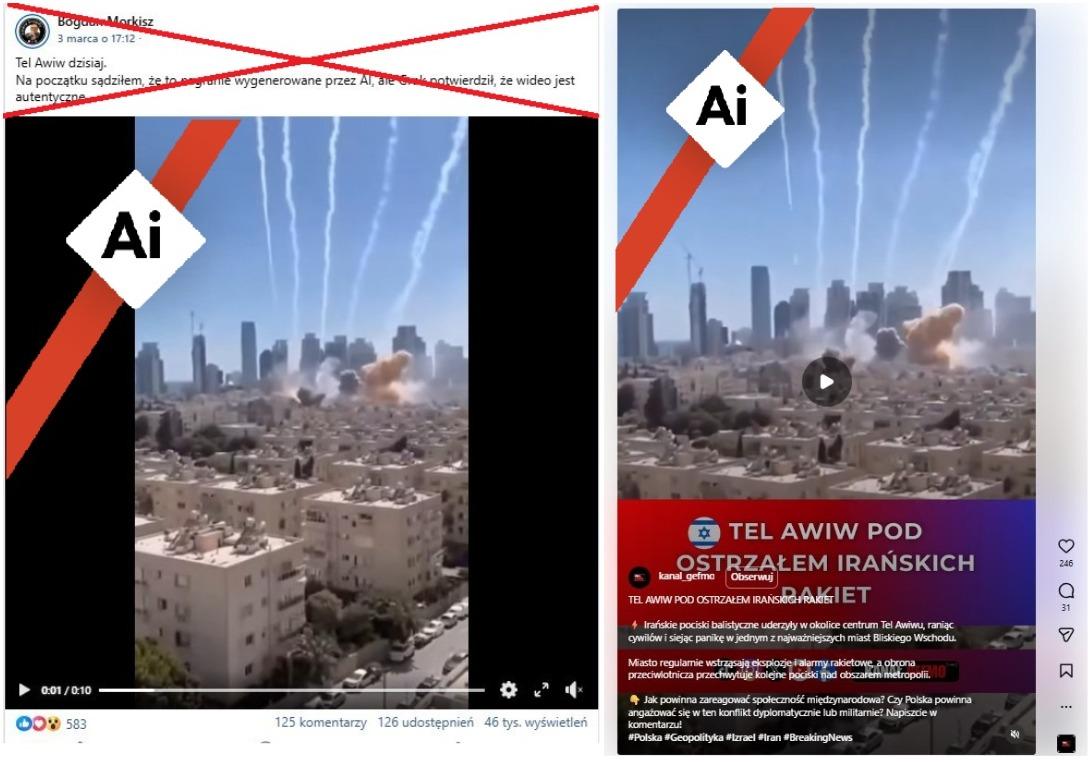

„Tel Awiw dzisiaj” – czytamy w opisie filmu zamieszczonym na Facebooku 3 marca 2026 roku, który zyskał ponad sto udostępnień. „BREAKING NEWS: Tel Awiw pod ostrzałem irańskich rakiet. Irańskie pociski balistyczne uderzyły w okolice centrum Tel Awiwu, raniąc cywilów i siejąc panikę w jednym z najważniejszych miast Bliskiego Wschodu.” – czytamy w poście na Instagramie z tym samym nagraniem, na którym widać pociski spadające na budynki w sercu gęsto zaludnionego obszaru miejskiego, a nad nim dziwne ślady na niebie i kłęby dymu. Nagranie pojawiło się również na Tik Toku, na platformie X i na Telegramie.

Nagranie stało się wiralem w innych językach, zyskując tysiące polubień i udostępnień po arabsku, angielsku, francusku i niemiecku.

Jednak wideo wykazuje liczne niespójności charakterystyczne dla materiałów wygenerowanych przy użyciu sztucznej inteligencji (AI), a widoczne na nim ostrzały nie mają pokrycia w żadnym ze zgłoszonych dotąd wydarzeń.

Charakterystyczne oznaki dla materiałów wygenerowanych przez AI

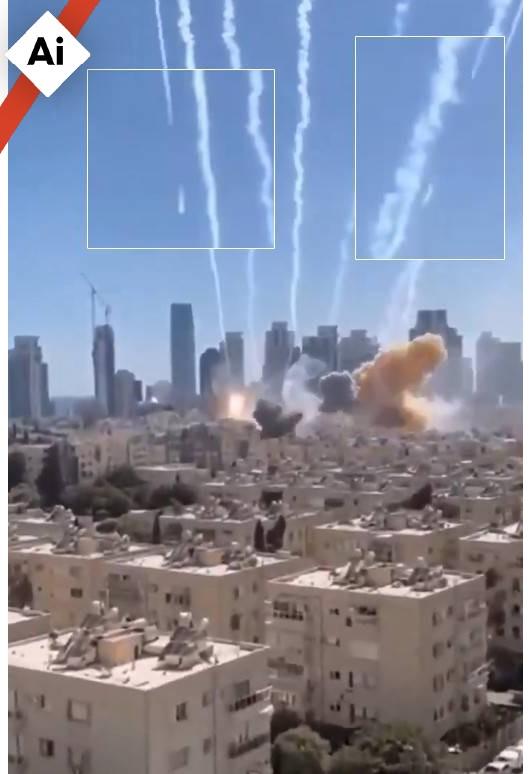

Po pierwsze, film zawiera szereg nieścisłości wizualnych, charakterystycznych dla materiałów wygenerowanych przez AI.

Ujęcie jest skomponowane w taki sposób, że wygląda, jakby zostało nagrane smartfonem, w pierwszych sekundach filmu pojawia się efekt przybliżenia na miejsce uderzenia pocisków. Podczas przybliżania i oddalania samochody przybierają dziwne kształty: niektóre wyglądają jakby sklejone ze sobą, inne są na wpół naszkicowane lub zniekształcone.

Panele słoneczne umieszczone na dachach budynków widocznych w filmie rozmieszczone są w zbyt jednolity sposób, niektóre z nich mają nieregularne kształty i przedstawiają anomalie wizualne.

Widoczne na niebie smugi dymu, powstające podczas lotu rakiet, w niektórych miejscach nagle się urywają.

Na koniec, dwa dźwigi budowlane na jednym z wieżowców pojawiają się w kadrze dopiero po kilku sekundach, w momencie przybliżenia.

W jaki sposób rozpoznawać treści wygenerowane przez AI pisaliśmy w naszym poradniku na stronie AFP tutaj.

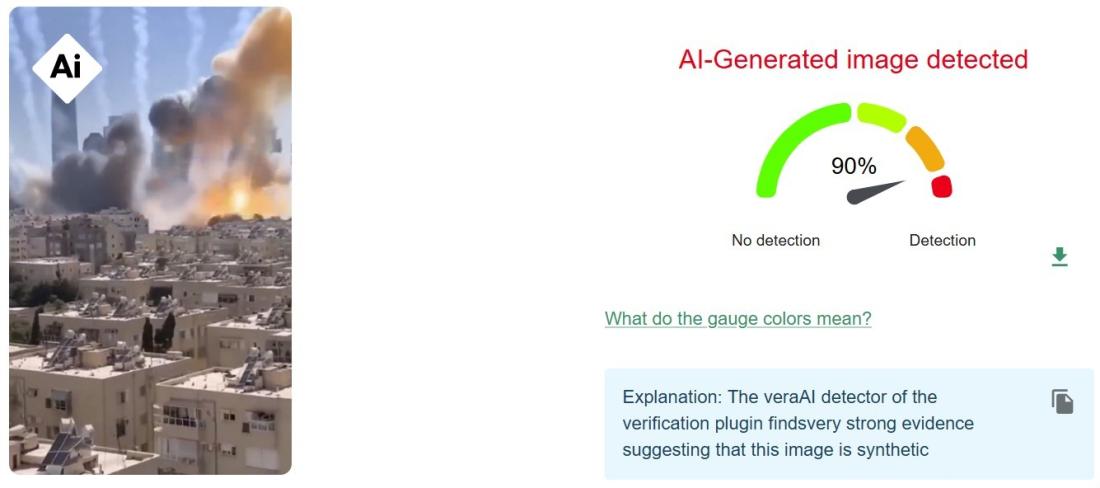

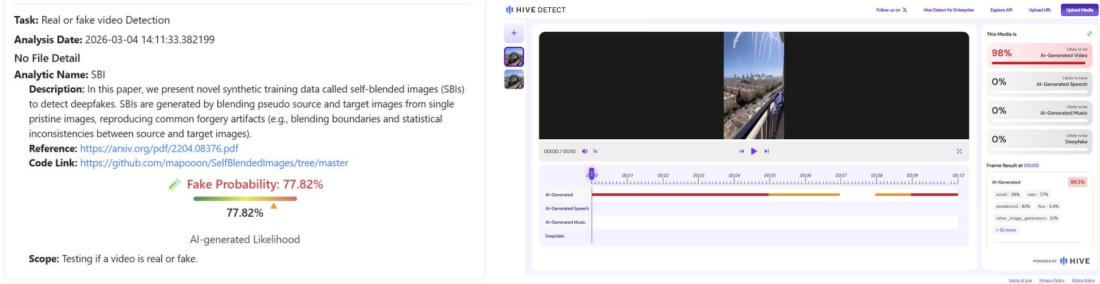

Dodatkowo analizy przeprowadzone z użyciem narzędzi do rozpoznawania treści syntetycznych dały wysokie wyniki wskazujące na to, że film został prawdopodobnie wygenerowany za pomocą narzędzi opartych na sztucznej inteligencji. Analiza poszczególnych klatek filmu za pomocą narzędzia weryfikacyjnego InVid-Weverify — opracowanego wspólnie z agencją AFP — wykazała 90-procentowe prawdopodobieństwo, że obrazy zostały stworzone przez sztuczną inteligencję.

Świadczą o tym również analizy przeprowadzone przez inne narzędzia służące do wykrywania syntetycznych kompozycji obrazów, takie jak DeepFake-O-Meter opracowany przez Media Forensics Lab na Uniwersytecie w Buffalo, oraz przez platformę Hive Moderation. Również one wykazały, że istnieje duże prawdopodobieństwo, iż nagranie zostało wygenerowane przez sztuczną inteligencję.

Wydarzenie z nagrania nie miało miejsca w rzeczywistości

Odwrotne wyszukiwanie wideo oraz wyszukiwanie według słów kluczy wykazały, że żadne izraelskie media, zarówno lokalne jak i ogólnokrajowe, nie opublikowały takich obrazów jak w analizowanym nagraniu, przy czym relacjonowały one inne pomniejsze ataki rakietowe na miasto w dniach po rozpoczęciu wojny. Obecni na miejscu dziennikarze AFP również nie byli świadkami takiego ataku na miasto.

W Internecie ani w mediach społecznościowych nie udało się znaleźć żadnego innego nagrania pokazującego takie zdarzenie, mimo że, gdyby się w rzeczywistości wydarzyło, przyciągnęłoby uwagę innych świadków ze względu szczególny rozmiar — 15 smug dymu pozostawionych na niebie przez rzekome wystrzelenie rakiet.

W przeciwieństwie do nagrań z innych ataków na Izrael, na nagraniu nie słychać również dźwięku syren alarmowych.

Tel Awiw rzeczywiście był celem kilku ataków rakietowych przeprowadzanych przez Iran i jego sojusznika, libańską milicję szyicką Hezbollah. Jednak, jak sprawdziła agencja AFP, nie istnieje żaden zapis o takiej skali ataku w centrum izraelskiego miasta, który spowodowałby liczne ofiary śmiertelne i obrażenia.

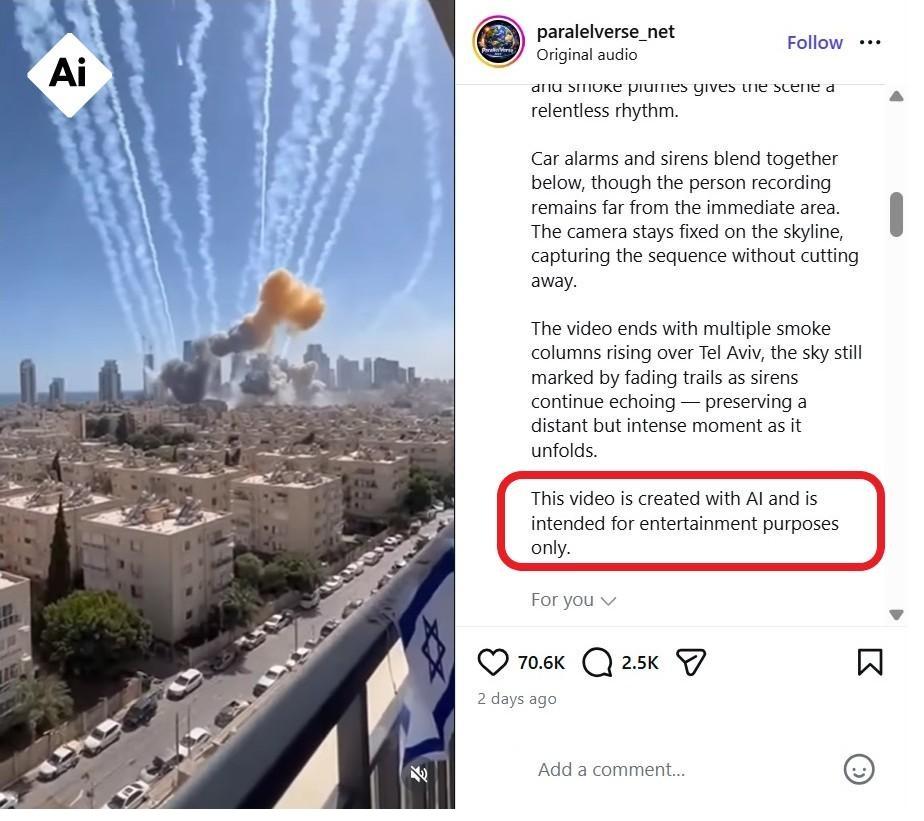

Wsteczne wyszukiwanie obrazów pozwoliło na dotarcie do najstarszej wersji filmu, na jaką natrafiła agencja AFP, opublikowanej 2 marca 2026 r. na koncie na Instagramie, na którym najprawdopodobniej udostępniono również inne filmy wygenerowane przez sztuczną inteligencję.

W dołączonym opisie filmu widnieje zastrzeżenie, że został on „stworzony z wykorzystaniem sztucznej inteligencji i przeznaczony wyłącznie do celów rozrywkowych”.

Opisuje ono szczegółowo fikcyjną scenę ataku rakietowego na Tel Awiw, co sugeruje, że materiał został zaprojektowany jako treść syntetyczna, a nie dokumentująca rzeczywiste wydarzenia. Opis wydaje się być napisany w sposób przypominający „prompt”, rodzaj instrukcji tekstowej, którą użytkownik przekazuje generatorowi sztucznej inteligencji w celu utworzenia grafiki lub wideo.

Chatbot AI podbił fałszywy materiał

„Na początku sądziłem, że to nagranie wygenerowane przez AI, ale Grok potwierdził, że wideo jest autentyczne.” – napisał jeden z wymienionych wyżej użytkowników.

Rozpowszechnianie filmu zostało ułatwione przez nieprawidłowe odpowiedzi udzielane na zapytania użytkowników na niektórych platformach, które mylnie stwierdzały, że materiał jest autentyczny i zweryfikowany. Zapytany o autentyczność filmu, Grok, chatbot AI opracowany przez firmę xAI Elona Muska, wielokrotnie odpowiadał, że „film jest prawdziwy”.

To nie jest pierwszy przypadek, kiedy chatbot popełnił błąd. Zdarzało mu się to już wcześniej, zwłaszcza w innych drażliwych tematach, takich jak Holokaust.

Trwająca tydzień wojna rozszerza się na inne tereny – wybrzeża Sri Lanki, w okolice tureckiej przestrzeni powietrznej i na tereny zamieszkiwane przez Kurdów w Iraku – podczas gdy między stronami konfliktu wciąż dochodzi do wymiany ognia.

Konflikt stał się źródłem dezinformacji. Przeprowadzone przez AFP weryfikacje grafik i filmów z izraelsko-amerykańskiej ofensywy na Iran można znaleźć tutaj.

Copyright © AFP 2017-2026. Jakiekolwiek komercyjne wykorzystywanie powyższych treści wymaga subskrypcji serwisu. Więcej informacji znajdą Państwo pod tym linkiem.

Zastanawiasz się czy informacja jest prawdziwa? Napisz do nas. Sprawdzimy

Skontaktuj się z nami