Zdjęcie z pogrzebu ofiar ataku na szkolę w Iranie wygenerowała sztuczna inteligencja

- Opublikowano 17/03/2026, 15:08

- Przeczytasz w ciągu 3 minut

- Autor: Lucía DIAZ, AFP Hiszpania

- Tłumaczenie: Maja CZARNECKA, AFP Poland

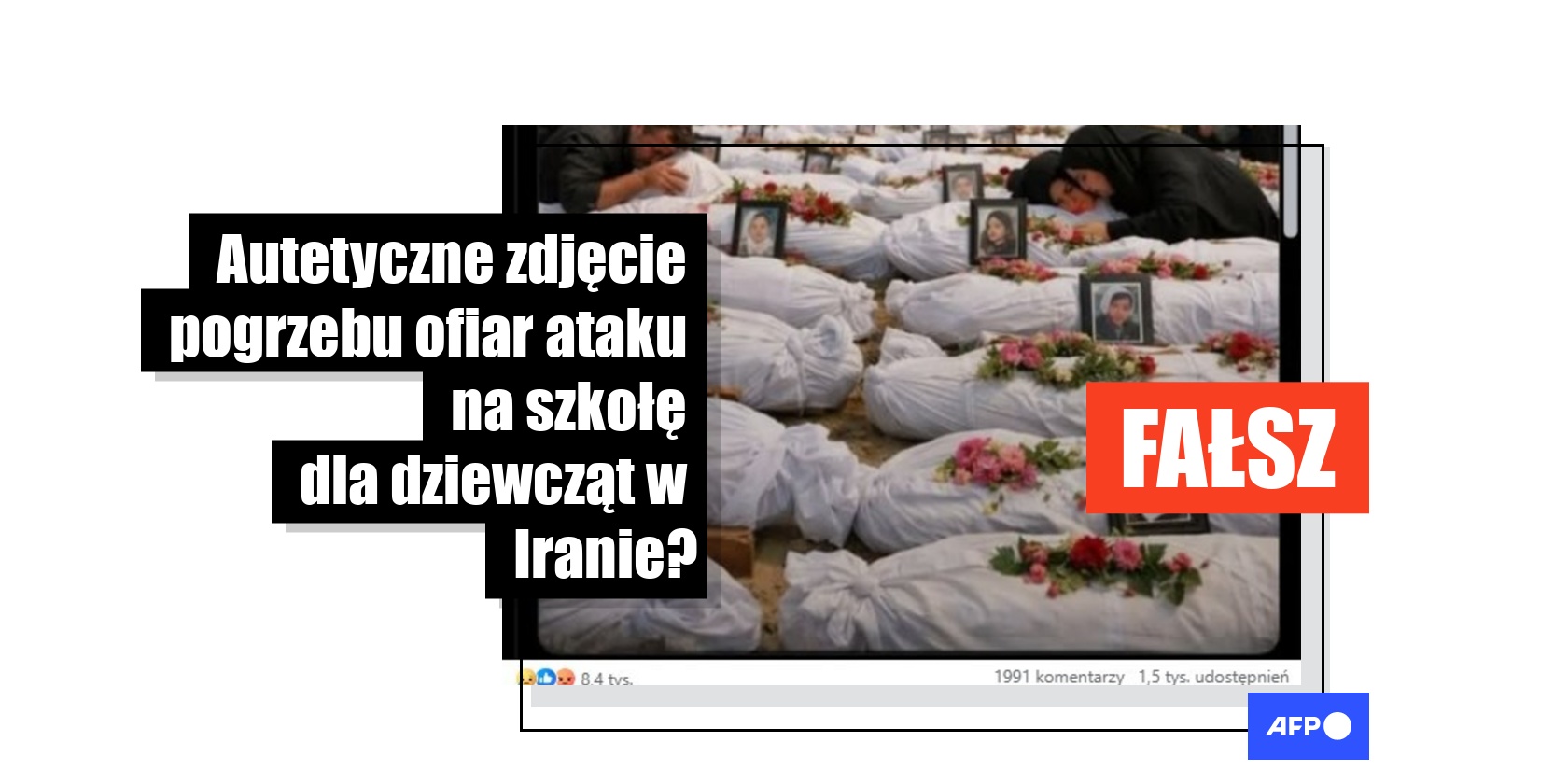

Pierwszego dnia wybuchu wojny na Bliskim Wschodzie, 28 lutego 2026 roku, irańskie media poinformowały o ataku na szkołę dla dziewcząt na południu kraju, w której zginęło ponad 150 osób. W tym kontekście, w mediach społecznościowych w wielu językach tysiące udostępnień zyskał obraz przedstawiający dziesiątki ciał przykrytych białym płótnem, a na nich umieszczone fotografie dziewcząt oraz kwiaty. Jednak grafikę stworzono za pomocą sztucznej inteligencji (AI). Agencja AFP ustaliła to na podstawie opinii ekspertów oraz dokładnej analizy wizualnej, przy użyciu narzędzi do detekcji sztucznie wygenerowanych zdjęć.

„Efekt żydowskiego ataku na szkołę w Iranie. 160 zabitych dzieci. Kolejna zbrodnia wojenna Izraela.” – głosi post na Facebooku opublikowany 4 marca 2026 roku. Grafikę podawali dalej inni użytkownicy Facebooka (tutaj i tutaj) i platformy X. W artykule na stronie nczas.info grafikę opatrzono błędnym podpisem mówiącym, że zdjęcie z „pogrzebu dziewczynek zabitych w szkole w irańskim Minabie” pochodzi od agencji PAP/EPA.

Ta sama grafika z podobnym opisem była rozpowszechniane m.in po rumuńsku, angielsku, hiszpańsku, francusku, portugalsku, grecku, holendersku i słowacku. Grafikę zamieściła również współzałożycielka lewicowego ugrupowania w brytyjskim parlamencie Your Part Zarah Sultana - bez informacji, że zdjęcie zostało wygenerowane przez AI.

28 lutego 2026 roku, po ataku USA i Izraela na Iran, irańskie władze poinformowały o ataku, w którym zginęło ponad 150 osób w szkole w Minab na południu kraju. Ani Stany Zjednoczone, ani Izrael nie potwierdziły ataku, a agencja AFP nie była w stanie dotrzeć na miejsce zdarzenia, aby to zweryfikować (zarchiwizowane linki tutaj i tutaj.)

Według śledztw dziennikarskich przeprowadzonych przez „The New York Times” i agencję prasową Reuters, mógł to być atak przeprowadzony przez Amerykanów na irańską bazę wojskową znajdującą się w pobliżu szkoły.

Rzeczniczka Biura Wysokiego Komisarza Narodów Zjednoczonych ds. Praw Człowieka, Ravina Shamdasani, wezwała do „szybkiego, bezstronnego i kompleksowego dochodzenia” w sprawie okoliczności zdarzenia i przypomniała, że bombardowanie obiektów cywilnych może być uznane za „zbrodnię wojenną”.

Prezydent Iranu Masud Pezeszkian powiedział, że jego kraj nie pozostanie „milczący” po tym ataku i kolejnym, który rzekomo miał miejsce dzień później na szpital. Tymczasem sekretarz stanu USA Marco Rubio oświadczył, że Stany Zjednoczone nie „celują” intencjonalnie w szkoły i dodał, że Pentagon prowadzi dochodzenie w tej sprawie.

W viralowej grafice kilka elementów wskazuje, że została ona stworzona przy użyciu sztucznej inteligencji, np. niektóre postacie w tle obrazu są rozmazane.

Ponadto taka scena nie pojawia się ani na fotografiach z pogrzebu opublikowanych przez irańską agencję informacyjną ISNA i udostępnianych przez AFP, ani na obrazach przekazywanych przez inne międzynarodowe media, np. turecką agencję Anadolu.

„To ewidentnie fałszywy obraz” – powiedział 6 marca 2026 r. Shu Hu, autor badań w dziedzinie sztucznej inteligencji i wykładowca informatyki i inżynierii na Uniwersytecie w Buffalo w Stanach Zjednoczonych, w rozmowie z AFP.

Zdaniem eksperta można to zaobserwować m.in. analizując kierunek padania cieni, które nie są „spójne”, w przypadku kwiatów zdają się być skierowane w dół, a w przypadku ramek ze zdjęciami – w górę.

Siwei Lyu, dyrektor Media Forensics Lab na Uniwersytecie w Buffalo i profesor Uniwersytetu Stanowego w Nowym Jorku, podzielił opinię Hu w kwestii „pikselowego nosa” na jednym ze zdjęć i dodał inne przykłady niespójności, takie jak „powielanie tych samych portretów” lub „nienaturalne” zagęszczenie perspektywy, które pokazują, że ilustracja „została wygenerowana za pomocą sztucznej inteligencji” – jak przekazał w rozmowie z AFP 6 marca 2026 r.

Huertas uważa, że „niska jakość” obrazu to „celowy zabieg mający na celu ukrycie faktu, że jest to sztuczna inteligencja”, ponieważ uniemożliwia dostrzeżenie innych nieścisłości, które często pojawiają się w obrazach syntetycznych, takich jak kształt dłoni.

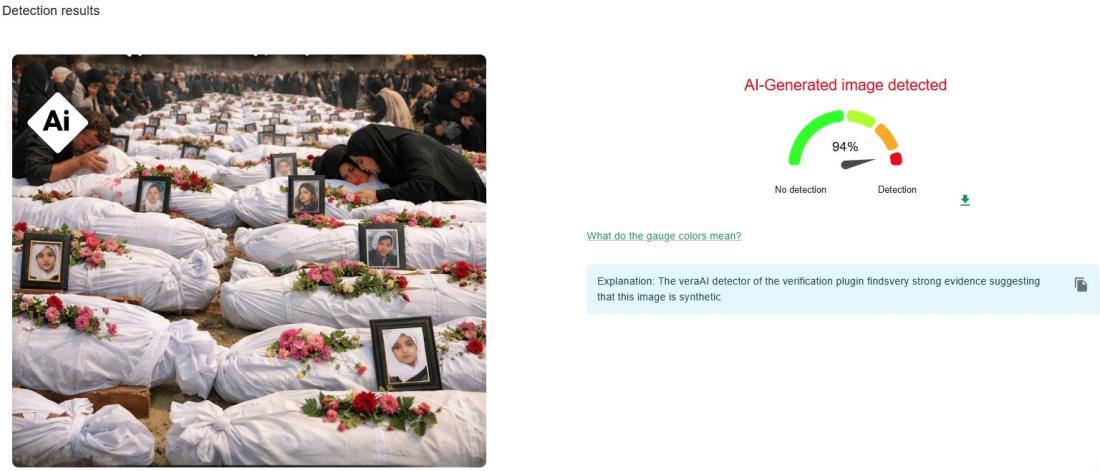

Analiza zdjęcia za pomocą narzędzia weryfikacyjnego InVid-Weverify – opracowanego wspólnie z agencją AFP – wskazała na wysokie prawdopodobieństwo – 94% – że grafika została stworzona przy pomocy sztucznej inteligencji.

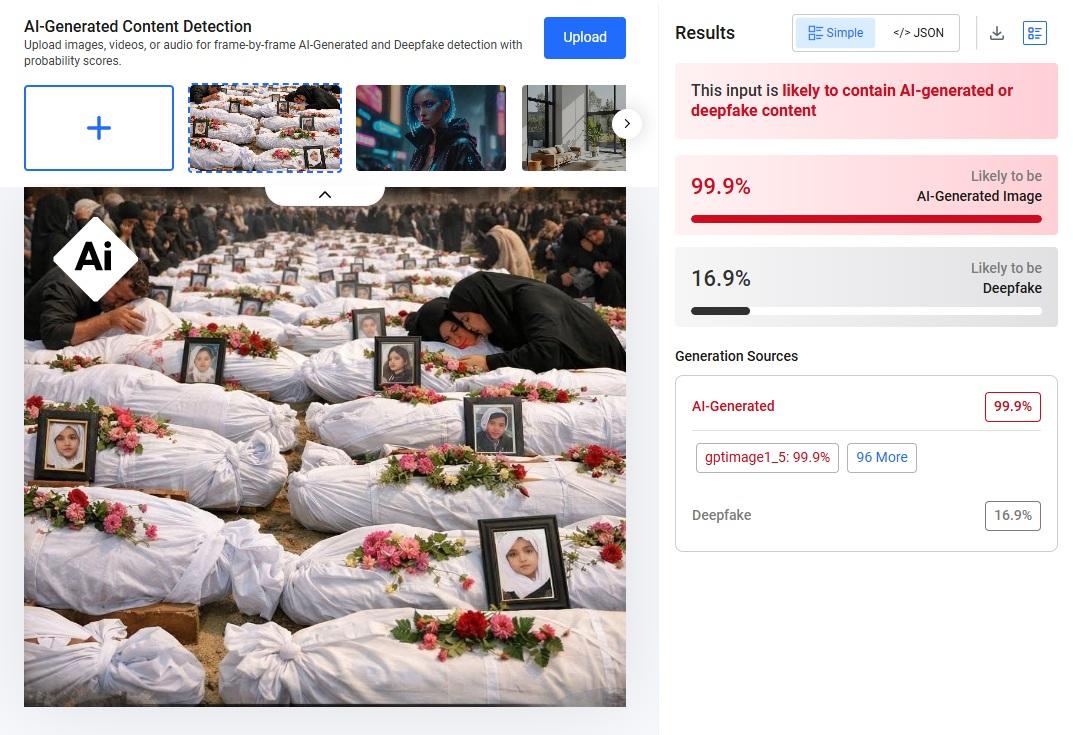

Również narzędzie Hive Moderation wskazało 99,99-procentowe prawdopodobieństwo, że obraz został wygenerowany przez sztuczną inteligencję. Detektor sztucznej inteligencji AI or Not także wskazuje na to, że obraz „prawdopodobnie został wygenerowany przez sztuczną inteligencję”.

Wojna na Bliskim Wschodzie wywołała ogromną falę dezinformacji. Agencja AFP zweryfikowała szereg zdjęć i filmów z początku izraelsko-amerykańskiej ofensywy przeciwko Iranowi, które można znaleźć tutaj i tutaj.

Copyright © AFP 2017-2026. Jakiekolwiek komercyjne wykorzystywanie powyższych treści wymaga subskrypcji serwisu. Więcej informacji znajdą Państwo pod tym linkiem.

Zastanawiasz się czy informacja jest prawdziwa? Napisz do nas. Sprawdzimy

Skontaktuj się z nami